¿Cómo utiliza el traductor de Google la Inteligencia Artificial?

Los investigadores de Google anuncian que sus redes neuronales artificiales para traducción están empezando a desarrollar, sin intervención humana, su propio idioma. La Inteligencia Artificial alcanza otro hito de enormes implicaciones.

Cuando en 1956 Arthur Samuel, considerado el padre del ‘machine learning’, comenzó a trabajar para lograr que su ordenador le ganase a las damas, es de suponer que no podía imaginar el desarrollo que tendría la disciplina que estaba creando.

El ‘machine learning’ permite a las máquinas, imitando lo poco que sabemos del comportamiento del cerebro humano, aprender sin necesidad de programación externa. Hace ya más de cinco décadas que los ordenadores nos ganan a las damas y, poco a poco, han sido capaces de avances mucho más llamativos: distinguir imágenes, traducir la voz humana, conducir un coche.... Ahora el ‘machine learning’ ha conquistado una nueva frontera: las máquinas han creado su propio idioma.

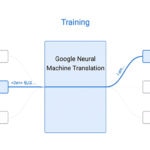

La noticia la dio Google en su blog de Investigación. Desde hace unos meses la compañía de Mountain View utiliza un nuevo sistema para sus servicios de traducción. Lo han llamado Neural Machine Translation System, y la gran novedad respecto a lo anterior, un sistema apoyado en lo que llama la ‘Comunidad de Traductores’, es que en vez de traducir palabra a palabra, la red neuronal interpreta la frase entera, tiene en cuenta su contexto y se preocupa de su sentido gramatical, lo que evita esas traducciones sin sentido que sólo sirven para hacer bromas.

Pero los investigadores de Google decidieron dar un paso más allá. En todas sus traducciones la máquina utilizaba como ‘puente’ el inglés: es decir, si hay que traducir del japonés al coreano, el sistema neuronal primero traduce el término al inglés y de allí al coreano. El experimento consistía en quitar de la ecuación el inglés, traducir directamente entre dos idiomas que la máquina no conoce. Y el resultado fue sorprendente.

La máquina traducía de forma razonablemente correcta, es decir, conectaba palabras y conceptos que no había visto antes enlazados. ¿Cómo lo hacía? Según los expertos de Google en Inteligencia Artificial, lo que sucedía es que el ordenador había desarrollado su propio lenguaje para representar los conceptos que luego traducía al otro idioma. La máquina no sabe traducir del coreano al japonés, pero sí sabe lo que significa en su propio idioma una palabra en coreano y también puede decirla en japonés.

Fuente: BBVA Innovation Center.

Las implicaciones de este descubrimiento son enormes. Para empezar, demuestra los enormes avances que está haciendo Google en Inteligencia Artificial. Es una carrera en la que compiten muchas empresas, algunas de enorme potencial como IBM y Microsoft, pero Google cuenta con la ventaja de su enorme arsenal de datos.

El desarrollo de este lenguaje artificial permitirá a Google mejorar sus sistemas de traducción automática. De momento, funcionan con redes neuronales las traducciones en francés, español, inglés, alemán, portugués, chino, japonés, turco y coreano. Pero lo realmente importante no es la traducción, sino la constatación, gracias a este avance, de que las máquinas cada vez son más inteligentes y nos necesitan menos.

La era de la percepción

La programación y la potencia de cálculo eran importantes en la prehistoria del ‘machine learning’. Ahora estamos en la era de la percepción, lo que es un salto cualitativo enorme. Trataremos de explicarlo con un ejemplo.

Mucho se habló a finales del siglo pasado (1997) de la derrota del excampeón del mundo de ajedrez Gary Kasparov ante el ordenador Deep Blue, de IBM. Arthur Samuel, que no vivió para verlo, se hubiese quedado boquiabierto. Hoy la tecnología detrás de ese éxito informático apenas nos haría pestañear. Si tenemos un ordenador como Deep Blue, previamente programado para ser capaz de analizar más de cientos de millones de movimientos, y con la potencia de cálculo suficiente para hacerlo en segundos, no habrá genio humano del ajedrez capaz de toserle.

¿Pero qué ocurre si la máquina percibe, sin necesidad de programación? Ese es el paso fundamental que se está dando, como explicaba a Teknautas Emmanuel Mogenet, de Google Research Europe: "Un niño sabe, por ejemplo, que los coches no vuelan. Nadie se lo ha dicho ni se lo ha enseñado. Lo ha aprendido de forma indirecta en el día a día, viéndolo en la calle, estando en contacto con el entorno a través de sus sentidos. Eso es lo que llamamos ‘percepción’ y es lo que estamos desarrollando ahora en 'software' mediante la creación de redes neuronales artificiales y el 'deep learning'".

Tampoco nadie ha dicho o ha enseñado al sistema de traducción de Google cómo decir una palabra japonesa en coreano. Nadie lo ha programado para saberlo, lo ha aprendido de forma indirecta, y ahora está dando el paso de crear su propia lengua. Las máquinas nos ganan a las damas, nos ganan al ajedrez, y dentro de muy poco hablarán entre ellas, probablemente sin que sepamos qué dicen exactamente.

El potencial de los avances del ‘machine learning’, y sus implicaciones filosóficas, es enorme.